Voy a ser claro desde el principio: si tu contenido no transmite E-E-A-T —Experiencia, Expertise, Autoridad y Confianza—, los modelos de lenguaje como ChatGPT, Claude y Perplexity van a pasar de largo sin pensárselo dos veces. No importa lo bien escrito que esté ni cuántas keywords tenga. Si la IA no percibe que hay alguien creíble detrás, simplemente no te cita.

Llevo más de 18 años en SEO y he visto de todo. Pero lo que está pasando ahora es diferente. Google diseñó el framework E-E-A-T para que evaluadores humanos puntuaran la calidad de los resultados de búsqueda. Era una guía interna, casi un manual de instrucciones. Lo que nadie anticipaba es que ese mismo concepto se convertiría en la moneda de cambio de la búsqueda con IA.

Porque los LLMs, cuando tienen que decidir a quién citar entre decenas de fuentes que hablan del mismo tema, no tiran una moneda al aire. Buscan señales de credibilidad. Y esas señales son, básicamente, E-E-A-T.

En esta guía te voy a explicar por qué esto importa más que nunca y, sobre todo, qué puedes hacer tú para que tu contenido pase el filtro de confianza de la IA.

¿Qué es E-E-A-T y por qué la IA lo usa como filtro?

Antes de meternos en estrategias, conviene entender bien de qué hablamos.

Los cuatro pilares, sin rodeos

E-E-A-T representa cuatro señales de calidad que Google formalizó en diciembre de 2022 cuando añadió la primera "E" de Experiencia al framework original. Cada pilar aporta algo distinto:

Experiencia es tener piel en el juego. Un análisis de producto escrito por alguien que lo ha usado durante seis meses tiene un peso que no consigue quien simplemente ha leído la ficha técnica. Los LLMs han aprendido a detectar esos detalles que solo aparecen cuando alguien ha vivido lo que cuenta: marcos temporales concretos, problemas inesperados que surgieron, matices que no encontrarías en una descripción genérica.

Expertise es saber de lo que hablas, y que se note. Para temas técnicos hablamos de formación, certificaciones, años de práctica. Para temas más cotidianos, se demuestra con profundidad de conocimiento y precisión consistente. Lo interesante es que los LLMs son particularmente buenos detectando expertise porque pueden cruzar tu contenido con millones de fuentes para verificar si lo que dices tiene sentido.

Autoridad va un paso más allá: no es solo lo que tú dices de ti mismo, sino lo que dicen los demás. ¿Te citan otras webs de tu sector? ¿Te mencionan en publicaciones relevantes? ¿Apareces como referencia cuando otros hablan de tu tema? Para la IA, que sintetiza información de múltiples fuentes, la autoridad funciona como un filtro potente para decidir qué voces amplificar.

Confianza es la base sobre la que se sostiene todo lo anterior. Puedes tener experiencia, expertise y autoridad, pero si has publicado información incorrecta, si no eres transparente con tus fuentes o si tu historial no es limpio, la confianza se desploma. Y cuando la confianza cae, los LLMs simplemente te descartan. Es el desempate definitivo.

Por qué Google lo creó y por qué la IA lo adoptó

Las Search Quality Evaluator Guidelines de Google fueron pensadas para humanos. Pero resulta que las mismas señales que hacen que un evaluador humano confíe en una fuente son las señales que los LLMs también aprenden a reconocer durante su entrenamiento.

Hay tres razones por las que esto funciona así. Primera: los LLMs se entrenan con datos donde el contenido E-E-A-T fuerte tiende a ser más preciso, más completo y más citado por otras fuentes. El modelo aprende esas correlaciones aunque nadie le haya dicho explícitamente "busca E-E-A-T". Segunda: muchos sistemas de búsqueda con IA —Google AI Overviews, Copilot de Bing— tiran directamente de la infraestructura de búsqueda tradicional, donde E-E-A-T ya influye en los rankings. Tercera: el objetivo fundamental de E-E-A-T (información fiable de fuentes creíbles) coincide exactamente con lo que los LLMs necesitan para generar respuestas que no sean inventadas.

Cómo los LLMs evalúan cada pilar de E-E-A-T

Esto es lo que me parece más fascinante del tema: la IA no evalúa E-E-A-T como lo haría un humano, pero ha desarrollado sus propios métodos para medir credibilidad. Y son más sofisticados de lo que la mayoría cree.

Experiencia: la IA detecta si lo has vivido o lo has copiado

Los LLMs se han vuelto bastante buenos distinguiendo entre contenido que refleja experiencia real y contenido que simplemente reorganiza lo que ya existe en internet. ¿Cómo lo hacen? A través de patrones. El contenido experiencial incluye detalles específicos, observaciones personales, conclusiones que solo sacas cuando has pasado por algo, matices que el contenido genérico no tiene.

Te pongo un ejemplo de mi propio campo. Cuando escribo sobre optimización para LLMs, menciono errores concretos que cometí con clientes, herramientas que probé y no funcionaron, tiempos reales de implementación. Eso no lo puede escribir alguien que ha leído tres artículos sobre el tema.

Para la búsqueda con IA, esto tiene una implicación clara: el contenido que demuestra experiencia de primera mano va a ganar cada vez más terreno frente a los resúmenes superficiales. Incluye anécdotas reales, evaluaciones honestas (también las negativas), y detalles que solo conoce quien ha estado ahí.

Expertise: no basta con decirlo, hay que demostrarlo

Las señales de expertise ayudan a los LLMs a decidir si una fuente tiene la profundidad necesaria para ser precisa. La IA evalúa esto a través de varios canales: la consistencia de la información a lo largo de tu contenido, la profundidad de las explicaciones, el uso correcto de terminología técnica, y la capacidad de abordar matices complejos sin caer en simplificaciones.

Un aspecto que me parece clave es la consistencia interna. Si tienes diez artículos sobre SEO y en tres dices una cosa y en otros tres la contradices, el LLM detecta esa inconsistencia y baja tu puntuación de expertise. No es algo consciente — el modelo simplemente ha aprendido que las fuentes fiables son coherentes consigo mismas.

¿Mi consejo? Crea contenido completo que aborde los temas a fondo. Demuestra que conoces las excepciones y los casos límite. Y mantén la coherencia en todo tu portfolio de contenido. Las credenciales y cualificaciones deben estar visibles, no como alardeo, sino como contexto que ayuda tanto a humanos como a máquinas a entender desde dónde hablas.

Autoridad: lo que importa es lo que otros dicen de ti

La autoridad es probablemente el pilar más difícil de construir porque depende de reconocimiento externo. No puedes fabricarla tú solo. Los LLMs evalúan la autoridad analizando cómo otras fuentes te referencian, te citan y hablan de ti.

Las señales que contribuyen: backlinks de calidad desde fuentes relevantes, menciones en publicaciones del sector, citas en contextos profesionales, reseñas y testimonios positivos, y un sentimiento general positivo cuando se habla de tu marca o de ti como profesional. La IA agrega todas estas señales para formarse una imagen completa.

Algo importante que mucha gente no sabe: la autoridad es específica del tema. Puedes ser una autoridad absoluta en marketing digital y no tener ninguna autoridad en temas médicos. Los LLMs son cada vez mejores reconociendo estos límites. Así que enfoca tus esfuerzos de construcción de autoridad en tu territorio real de expertise, no intentes abarcar todo.

Confianza: el filtro final que la IA aplica sin piedad

La confianza funciona como el filtro definitivo. El LLM puede reconocer que una fuente tiene experiencia, expertise y autoridad, pero si las señales de confianza son débiles o negativas, puede excluirla de todas formas.

Los LLMs evalúan la confianza en varias dimensiones. La precisión se comprueba cruzando tus afirmaciones con otras fuentes. La transparencia se mide a través de la claridad en la autoría, las fuentes que citas, y si revelas posibles conflictos de interés. La consistencia importa porque las fuentes que se mantienen fiables a lo largo del tiempo generan más confianza que las que dan bandazos.

Y para temas YMYL (Your Money or Your Life) — salud, finanzas, seguridad — los requisitos de confianza son especialmente estrictos. Los LLMs están programados para ser extremadamente cautelosos con este tipo de contenido. Si tu web trata temas YMYL y no tienes señales de confianza fuertes, estás jugando en desventaja severa.

Por qué E-E-A-T importa más para los LLMs que para el SEO tradicional

Siempre ha importado, sí. Pero en el contexto de la IA, su importancia se multiplica. Te explico por qué.

De buscar por keywords a buscar por credibilidad

En el SEO de toda la vida, una buena parte del trabajo consistía en asegurarte de que tu contenido incluyera las palabras que la gente buscaba. Y eso sigue siendo relevante. Pero los LLMs han introducido un cambio profundo: la selección basada en credibilidad.

Cuando un LLM genera una respuesta, no hace matching de keywords y ya. Sintetiza información de múltiples fuentes para construir una respuesta completa. En ese proceso tiene que tomar decisiones constantemente: ¿en qué fuente confío? ¿Qué afirmación incluyo? ¿Qué perspectiva priorizo? E-E-A-T influye directamente en cada una de esas decisiones.

Esto tiene implicaciones muy prácticas. Contenido que rankea bien en Google pero tiene señales E-E-A-T débiles puede quedar fuera de las respuestas de IA por completo. Y al revés: contenido con E-E-A-T excepcional puede ser seleccionado aunque no esté optimizado para keywords de forma tradicional. Estamos pasando de una era de ser encontrados a una era de ser confiados.

Cómo la IA sintetiza y decide a quién cita

A diferencia de Google tradicional, que te presenta una lista de enlaces para que tú elijas, los LLMs sintetizan la información en una respuesta única. Ese proceso de síntesis cambia la dinámica por completo.

Si varias fuentes dan información contradictoria, la IA tiene que elegir a cuál creer. ¿Y qué criterio usa? E-E-A-T. Especialmente confianza y autoridad.

Además, muchos sistemas de IA ahora incluyen citas con sus respuestas. Esas citas son oportunidades de visibilidad muy valiosas. Pero cuando la IA puede elegir entre docenas de fuentes que cubren el mismo tema, gravita naturalmente hacia las que tienen señales de credibilidad más fuertes. Las fuentes con E-E-A-T débil pueden ser leídas e incorporadas en la síntesis… sin recibir crédito de citación. Lo peor de ambos mundos.

Estrategias prácticas para optimizar E-E-A-T en búsqueda con IA

Bien, ya entendemos el porqué. Ahora vamos al cómo. Estas son las estrategias que aplico con mis clientes y que mejores resultados están dando.

Crea entidades de autor que los LLMs puedan reconocer

Esta es una de las estrategias más efectivas que conozco. No basta con poner tu nombre al final del artículo. Tienes que construir una identidad digital completa que la IA pueda rastrear y verificar.

Empieza por crear páginas de autor detalladas con tu trayectoria profesional, credenciales relevantes, áreas de expertise y enlaces a tu trabajo publicado. Usa el mismo nombre en todas las plataformas para que los LLMs conecten los puntos entre tus distintas presencias online. Implementa schema Person para darle a la IA datos estructurados sobre ti que pueda procesar fácilmente.

Y algo que mucha gente subestima: construye presencia en plataformas de terceros. Artículos como invitado en publicaciones del sector, perfiles en redes profesionales, participaciones en foros reconocidos… Todo eso crea validación externa que refuerza tu entidad de autor. Cuando los LLMs encuentren tu contenido, podrán cruzar esas señales para confirmar que tus afirmaciones de expertise son legítimas.

Construye autoridad temática con clusters de contenido

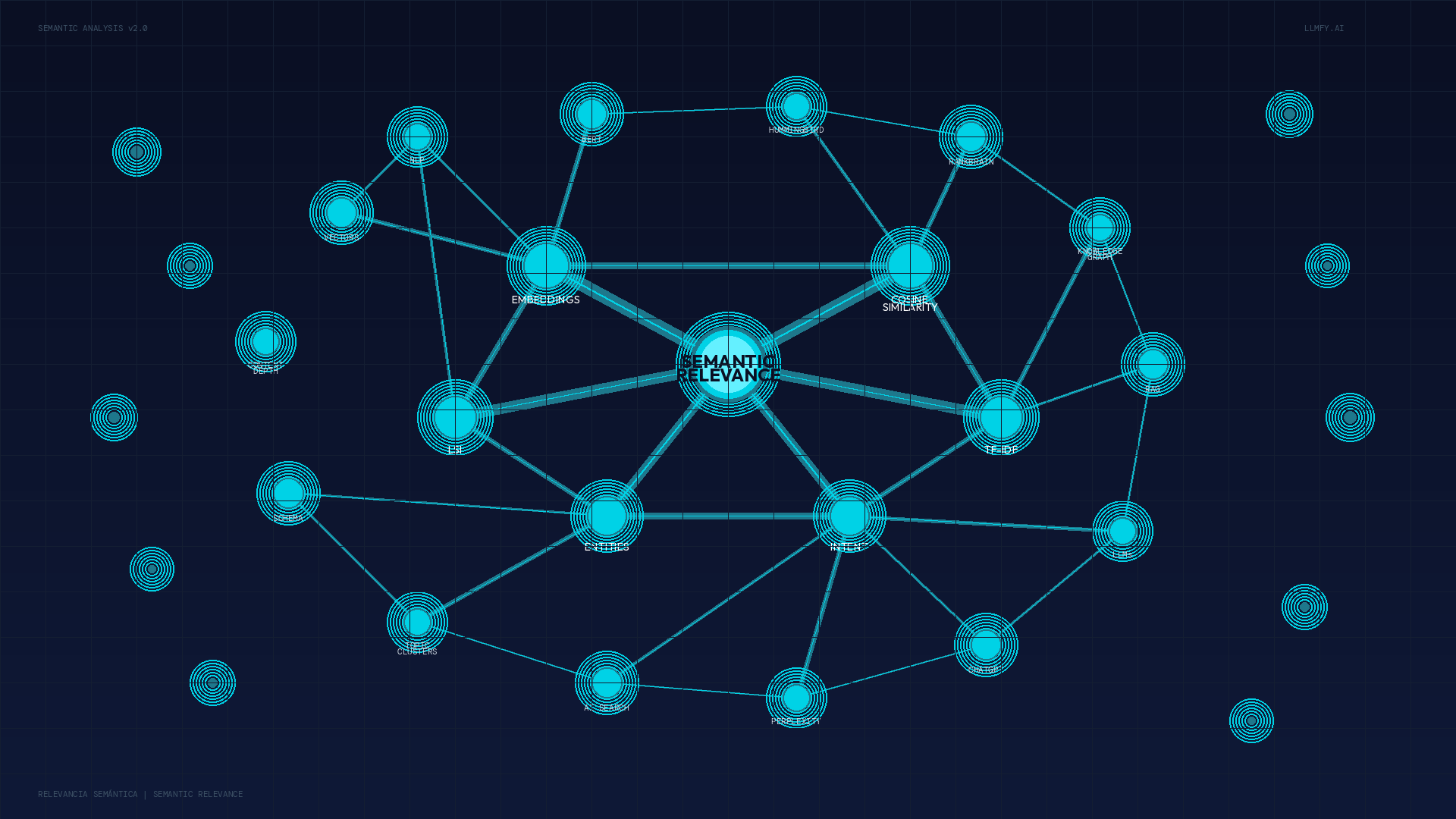

La autoridad temática — cubrir un tema de forma exhaustiva a través de contenido interconectado — envía señales E-E-A-T muy fuertes tanto a Google como a los LLMs. Este concepto está íntimamente relacionado con la relevancia semántica, que mide hasta qué punto tu contenido se alinea con el significado real de las búsquedas.

En vez de crear páginas sueltas, desarrolla clusters completos. Una página pilar con una visión global del tema, apoyada por artículos detallados que exploren cada subtema en profundidad. Todo interenlazado estratégicamente, formando una red que demuestra cobertura sistemática.

Para los LLMs esto es especialmente importante. Cuando la IA busca respuestas completas a preguntas complejas, se inclina naturalmente hacia fuentes que han demostrado la capacidad de abordar un tema desde múltiples ángulos con expertise consistente. Las páginas sueltas que tocan temas de pasada simplemente no compiten.

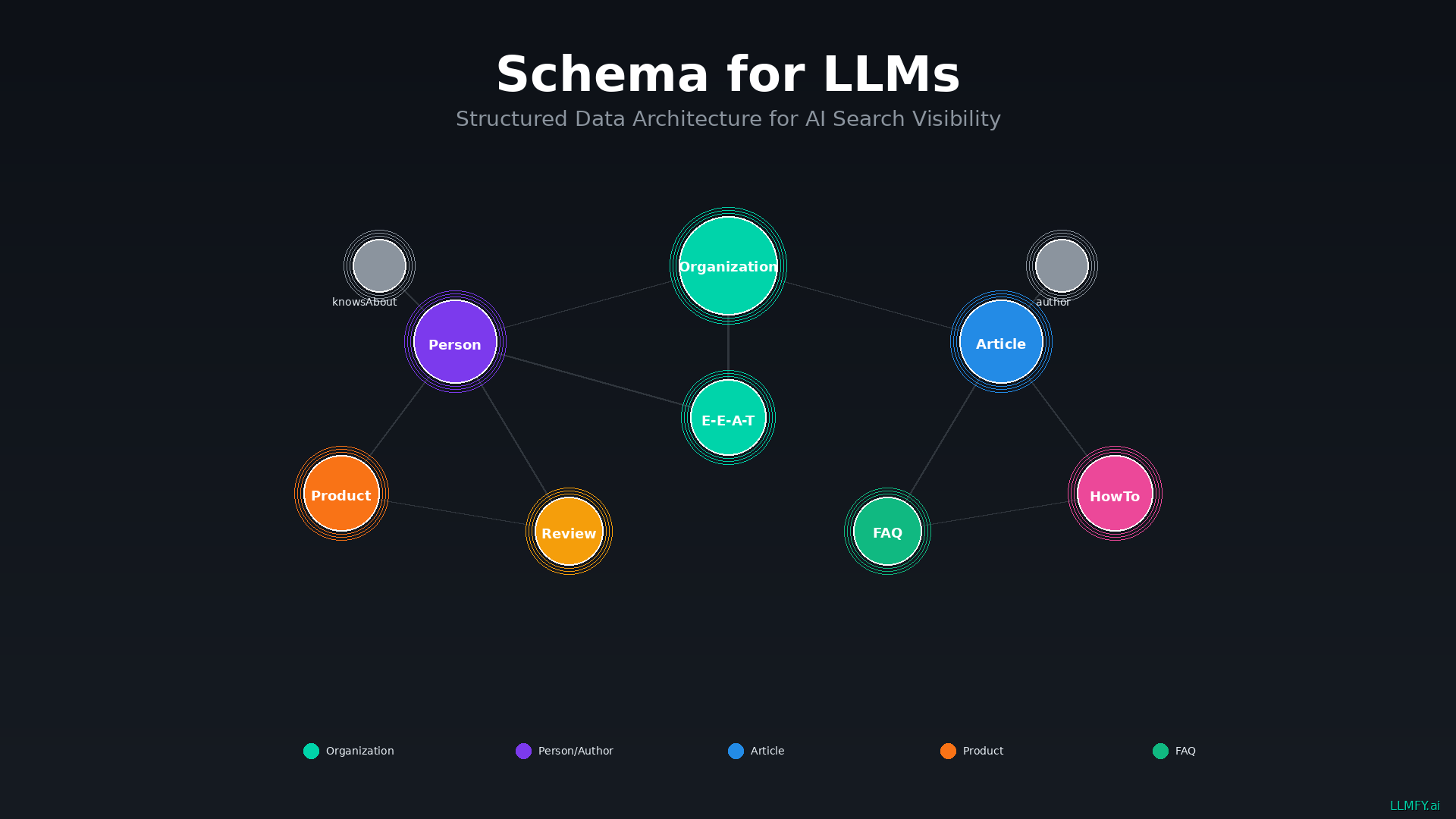

Aprovecha el schema markup para transmitir señales E-E-A-T

Los datos estructurados son tu forma de hablarle directamente a los sistemas de IA en un lenguaje que entienden sin ambigüedad.

Los tipos de schema más relevantes para E-E-A-T son: Organization (credenciales del negocio, fecha de fundación, certificaciones), Person (credenciales del autor, áreas de expertise, afiliaciones), Article (fechas de publicación, autoría, editor), y Review/Rating (prueba social y confianza del usuario).

Mi recomendación es implementar schema completo en todo tu sitio, no solo en las páginas donde quieras rich snippets. Para una guía detallada de implementación, tenemos esto: Schema para LLM: La Guía Completa de Datos Estructurados para Motores de Búsqueda con IA.

Consigue backlinks y menciones de calidad orientados a visibilidad IA

Los backlinks y menciones de fuentes autorizadas siguen siendo señales E-E-A-T potentes en la era de la IA. Cuando un sitio web reputado enlaza tu contenido o menciona tu marca como autoridad, esa validación externa influye de forma significativa en cómo los LLMs perciben tu credibilidad.

Pero la naturaleza de los backlinks valiosos está evolucionando. Para la optimización LLM, la relevancia contextual importa más que nunca. Una mención desde una fuente altamente autorizada dentro de tu nicho específico pesa más que docenas de enlaces desde directorios genéricos. Los LLMs pueden evaluar la alineación temática entre quien enlaza y quien es enlazado.

Enfoca tus esfuerzos en conseguir reconocimiento de fuentes en las que los LLMs confían: publicaciones establecidas del sector, instituciones educativas, recursos gubernamentales, organizaciones profesionales reconocidas. Esos enlaces amplifican tus señales E-E-A-T de maneras que los enlaces de baja calidad simplemente no pueden igualar.

Cómo medir y monitorizar tu rendimiento E-E-A-T

Optimizar sin medir es como conducir con los ojos cerrados. Aunque E-E-A-T no se puede reducir a un solo número, hay varios indicadores que te dan una imagen bastante clara.

Métricas que funcionan como proxies de E-E-A-T

Domain Authority y métricas similares, aunque imperfectas, te dan una idea de la credibilidad general de tu dominio. El volumen de búsqueda de marca sugiere que tu reconocimiento y autoridad están creciendo. Las métricas de calidad de backlinks revelan si fuentes autorizadas están validando tu expertise.

A nivel de contenido, fíjate en el tiempo en página y las métricas de engagement — si la gente se queda y lee, es señal de que tu contenido cumple expectativas. Las tasas de visitantes que repiten sugieren que encontraron valor suficiente para volver. Los compartidos sociales y las menciones naturales indican que otros consideran tu contenido digno de amplificar.

Mi recomendación: haz auditorías E-E-A-T regulares que examinen tus credenciales de autor y su visibilidad, la exhaustividad y precisión del contenido, tu perfil de backlinks con énfasis en autoridad y relevancia, patrones de engagement, y tu posicionamiento frente a competidores.

Rastrea tu visibilidad en las respuestas de IA

Quizás la medida más directa de si tu E-E-A-T está funcionando es comprobar si realmente apareces en las respuestas generadas por IA. En LLMFY hemos desarrollado herramientas específicas para esto: rastrear la visibilidad de tu marca y contenido en las principales plataformas LLM.

Lo que recomiendo es testear regularmente consultas relacionadas con tus temas principales en ChatGPT, Claude, Perplexity y Google AI Overviews. Apunta si tu marca aparece, si las citas enlazan a tu contenido, y cómo te comparas con la competencia. Esos datos te dan inteligencia directa para ajustar tu estrategia.

Resultados reales: casos de éxito con E-E-A-T en IA

La teoría está bien, pero los resultados hablan más alto.

En nuestro trabajo con clientes de diversos sectores, hemos visto patrones consistentes que vinculan mejoras en E-E-A-T con mayor visibilidad en búsqueda con IA. Los resultados son especialmente llamativos en nichos YMYL competitivos.

Un cliente de servicios financieros implementó un programa completo de optimización E-E-A-T: bios de autor detalladas con credenciales verificadas, schema markup completo, y una estrategia de clusters de contenido cubriendo temas de finanzas personales. En cuatro meses, su contenido empezó a aparecer en un 65% más de respuestas de IA sobre asesoramiento financiero frente a la línea base. Y lo más significativo: observaron un aumento del 40% en citas directas desde sistemas de IA — visibilidad que las métricas SEO tradicionales ni siquiera captarían.

Un editor de contenido de salud vio resultados similares tras reforzar señales E-E-A-T con atribución de autoría por profesionales médicos, procesos de revisión por pares documentados en las secciones de metodología, y citas de fuentes médicas autorizadas. Su visibilidad en respuestas de IA sobre salud mejoró un 78%, con un rendimiento especialmente fuerte en consultas donde la precisión y la confianza son absolutamente esenciales.

La conclusión de estos casos es clara: la inversión en E-E-A-T se traduce directamente en visibilidad LLM. Mejor identificación de autor, contenido más riguroso, validación externa más sólida — todo eso paga dividendos tanto en búsqueda tradicional como en IA.

Conclusión: E-E-A-T ya no es opcional

Mira, puedo resumírtelo en una frase: en un mundo donde la IA elige a quién citar, E-E-A-T es tu carta de presentación.

Experiencia, Expertise, Autoridad y Confianza han dejado de ser conceptos abstractos de calidad. Son los factores prácticos que determinan si tu contenido es seleccionado, citado y amplificado por los modelos de lenguaje. Y los profesionales y empresas que inviertan en optimizar estas señales hoy van a tener una ventaja competitiva enorme a medida que la búsqueda con IA siga creciendo.

En LLMFY, nuestra herramienta E-E-A-T Analyzer evalúa las señales de Experiencia, Expertise, Autoridad y Confianza de tu web tal como las perciben los LLMs. Examina tus entidades de autor, la profundidad de tu contenido, la autoridad de tus backlinks, la implementación de schema y las menciones de tu marca para darte una puntuación E-E-A-T accionable.

→ Inicia tu Análisis E-E-A-T gratuito y descubre cómo los motores de búsqueda con IA perciben la credibilidad de tu contenido.

Fuentes

- Google Search Quality Evaluator Guidelines - https://guidelines.raterhub.com/

- Google Search Central: Creando Contenido Útil, Fiable y Orientado a Personas - https://developers.google.com/search/docs/fundamentals/creating-helpful-content

- Documentación Oficial de Schema.org - https://schema.org/docs/documents.html

- Google Search Central: E-E-A-T y Quality Rater Guidelines - https://developers.google.com/search/blog/2022/12/google-raters-guidelines-e-e-a-t

- Investigación de Anthropic sobre Evaluación de Contenido IA - https://www.anthropic.com/research

- Documentación de OpenAI sobre Calidad de Contenido - https://platform.openai.com/docs/

- Guías de Webmaster de Microsoft Bing - https://www.bing.com/webmasters/help/webmaster-guidelines-30fba23a

- Web Data Commons: Análisis de Datos Estructurados - https://webdatacommons.org/

Jesus LopezSEO

Experto en LLMO y Fundador de LLMFY

SEO expert with over 18 years of experience. Pioneer in LLMO (Large Language Model Optimization) and founder of Posicionamiento Web Systems. Helping companies optimize their presence in traditional search engines and AI search engines.